L’ère du silence visuel : Pourquoi OpenAI parie tout sur l’audio

Depuis le lancement de ChatGPT, notre relation à l’intelligence artificielle s’est construite à travers un rectangle de verre lumineux. Mais en 2026, cette dépendance aux écrans pourrait toucher à sa fin. Avec sa nouvelle stratégie OpenAI Audio-First 2026, la firme de Sam Altman opère un pivot radical : transformer l’IA en un compagnon invisible, capable de comprendre non seulement nos mots, mais aussi nos émotions, nos hésitations et notre environnement sonore immédiat. Ce n’est plus un simple outil de recherche, c’est une présence ambiante qui aspire à devenir le « troisième pilier » de notre vie numérique, aux côtés du smartphone et de l’ordinateur.

La restructuration interne : L’audio devient le cœur du réacteur

Pour réussir ce pari, OpenAI a dû briser ses propres silos. Historiquement, les modèles de voix n’étaient que des couches superficielles ajoutées sur un moteur textuel (le fameux triptyque Speech-to-Text / LLM / Text-to-Speech). Ce processus, bien que fonctionnel, créait une latence frustrante et une voix souvent désincarnée.

Fin 2024, une restructuration massive a fusionné les pôles de recherche en audio, vision et langage. L’objectif ? Créer un modèle natif multimodal. Désormais, l’IA ne traduit plus le son en texte pour réfléchir ; elle « pense » directement en fréquences sonores. Cette unification permet une compréhension holistique : si vous soupirez de fatigue en posant une question, l’IA ajustera sa réponse pour être plus concise et apaisante, sans que vous ayez à formuler votre état émotionnel.

Prouesses techniques : Vers une conversation « sans couture »

La fin de la latence et des monologues

Le modèle attendu pour mars 2026 promet d’effacer la frontière entre l’homme et la machine grâce à des performances techniques inédites :

- Latence sub-200ms : Un temps de réponse quasi instantané, calqué sur le rythme naturel d’une conversation humaine.

- Gestion des interruptions : Contrairement aux assistants actuels, le nouveau modèle sait s’arrêter net quand vous lui coupez la parole, ou même parler en même temps que vous pour acquiescer.

- Prosodie émotionnelle : L’IA est capable de rire, de chuchoter pour ne pas réveiller un enfant, ou d’adopter un ton solennel selon le contexte.

Cette fluidité transforme l’interaction : on ne « commande » plus une machine, on collabore avec un partenaire qui saisit les nuances du langage non-verbal.

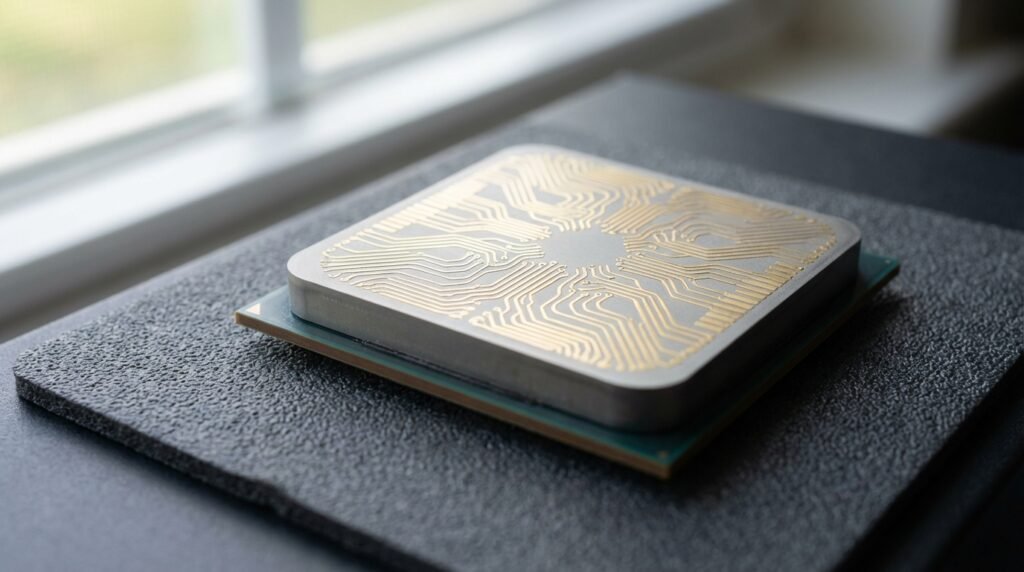

Le hardware ‘Post-Écran’ : Le design de Jony Ive au service de l’invisible

L’annonce la plus spectaculaire reste l’implication de Jony Ive, l’architecte légendaire de l’iPhone. Après l’acquisition de sa structure « LoveFrom » (renommée IO au sein d’OpenAI) pour 6,5 milliards de dollars, les contours du premier appareil physique se dessinent. Loin des casques VR encombrants, OpenAI mise sur la discrétion absolue.

Le projet, nom de code « Gumdrop », prendrait la forme de wearables minimalistes : un stylo intelligent capable de transcrire vos notes manuscrites tout en écoutant vos réflexions à voix haute, ou des pendentifs de la taille d’un iPod Shuffle. Sam Altman décrit l’expérience comme une « cabane au bord d’un lac » : une technologie calme, belle et ludique, qui ne réclame pas votre attention par des notifications visuelles, mais se tient prête, tel un secrétaire invisible, à percevoir votre environnement via des micros et des caméras miniatures.

OpenAI Audio-First 2026 : Le défi de la vie privée et de la surveillance acoustique

Si la promesse de nous libérer de l’addiction aux écrans est séduisante, elle soulève un débat sociétal majeur sur la surveillance acoustique permanente. Pour être efficace, un compagnon audio-first doit rester en écoute constante. Comment garantir que les fragments de vie captés — des conversations privées aux bruits de fond domestiques — ne soient pas utilisés pour du profilage publicitaire ou de l’entraînement de modèles sans consentement ?

Les critiques pointent du doigt le risque d’une « boîte noire » sonore. OpenAI devra prouver que le traitement des données peut se faire localement (Edge Computing) plutôt que dans le cloud pour rassurer les régulateurs. De plus, l’acceptabilité sociale d’un appareil qui « entend tout » reste à construire. Serons-nous prêts à sacrifier notre intimité acoustique pour le confort d’un assistant omniscient ?

Conclusion : Un saut dans l’inconnu

Le pivot audio d’OpenAI marque la fin de l’ère de l’interface graphique telle qu’on la connaît. En 2026, la technologie ne sera plus devant nos yeux, mais dans nos oreilles et autour de nous. Si le génie de Jony Ive parvient à rendre ces objets aussi indispensables que l’iPhone l’a été, nous pourrions enfin lever les yeux de nos smartphones. Mais ce futur « sans écran » impose une vigilance accrue : dans un monde où la voix est reine, le silence pourrait devenir le luxe ultime.