Fini le temps où l’IA était synonyme de data centers titanesques engloutissant l’énergie d’une petite ville. Le CES 2026, qui vient de fermer ses portes à Las Vegas, a marqué un tournant décisif : celui de la décentralisation. Alors que 2024 et 2025 étaient obsédés par la taille des modèles, 2026 consacre l’efficacité. Bienvenue dans l’ère de l’Edge AI et des SLM (Small Language Models).

David contre Goliath : La revanche des modèles compacts

Jusqu’à présent, la règle était simple : plus c’est gros, plus c’est intelligent. Mais cette course au gigantisme a atteint un mur de latence et de coût. Au CES cette année, la star n’était pas un nouveau GPT-6 omniscient, mais une armée de modèles compacts, agiles et surprenants.

On parle ici de modèles comme le Phi-4 mini de Microsoft (3,8 milliards de paramètres) ou le nouveau Gemma 3 de Google. Contrairement à leurs grands frères qui nécessitent des serveurs distants, ces SLM tournent directement sur votre machine. Le résultat ? Une fluidité déconcertante. Plus besoin d’attendre cette petite seconde de latence avant qu’un chatbot ne réponde. L’interaction devient instantanée, presque organique.

Le Hardware reprend le pouvoir : RTX 50 et NPUs

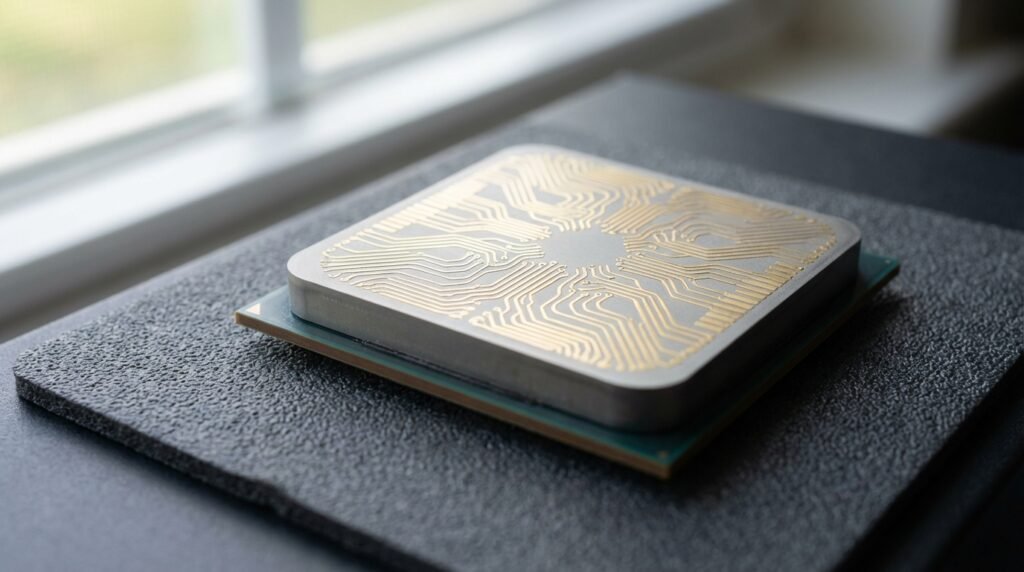

Cette révolution logicielle ne serait rien sans les muscles pour la porter. Nvidia l’a bien compris. Jensen Huang a profité du salon pour dévoiler la très attendue série GeForce RTX 50 basée sur l’architecture Blackwell. Au-delà des performances graphiques, ces cartes sont vendues comme des moteurs d’inférence locaux.

L’annonce clé ? L’intégration native des microservices Nvidia ACE sur les PC grand public. Concrètement, cela signifie que votre ordinateur peut désormais animer des avatars numériques ou faire tourner des assistants vocaux complexes sans envoyer une seule donnée vers le cloud. D’autres acteurs comme Hailo avec son accélérateur Hailo-10 prouvent que l’on peut générer des images via Stable Diffusion en local, sans connexion internet, et sans faire fondre son processeur.

Pourquoi l’IA « On-Device » change la donne

Pourquoi s’embêter à faire tourner l’IA chez soi alors que le Cloud le fait très bien ? Pour trois raisons majeures qui redéfinissent nos usages :

- Confidentialité absolue : C’est l’argument massue. Avec un SLM local, vos données de santé, vos documents financiers ou vos brouillons d’emails ne quittent jamais votre disque dur. La « souveraineté des données » n’est plus un concept politique, mais une réalité technique.

- Latence zéro : Dans le jeu vidéo ou la traduction instantanée, chaque milliseconde compte. L’Edge AI supprime les allers-retours réseau. L’IA réagit aussi vite que vous tapez.

- Sobriété énergétique : Faire tourner un petit modèle spécialisé sur une puce optimisée (NPU) consomme une fraction de l’énergie requise pour interroger un modèle géant via des centres de données énergivores.

Vers une « Physical AI »

L’autre tendance lourde observée dans les allées du CES est le glissement vers ce que Nvidia appelle la « Physical AI ». Il ne s’agit plus seulement de générer du texte ou des images, mais de comprendre et d’agir sur le monde physique. Des robots aux drones autonomes, l’intelligence embarquée permet des prises de décision critiques en temps réel, là où une coupure de connexion serait fatale.

L’avis de Just Tech

Ce CES 2026 dessine une rupture fascinante. Nous passons d’une IA « locataire » (on loue de l’intelligence via une API payante) à une IA « propriétaire » (on possède le modèle et le matériel pour le faire tourner). C’est une excellente nouvelle pour la vie privée et la rapidité. Mais attention à la fracture numérique qui se profile. Si l’intelligence dépend de la puissance de votre carte graphique, nous risquons de voir émerger un web à deux vitesses : ceux qui ont les moyens de s’offrir des assistants locaux ultra-rapides et privés, et ceux qui devront se contenter de services cloud plus lents ou moins respectueux de leurs données. L’indépendance technologique a un prix, et il se paye désormais en téraflops.