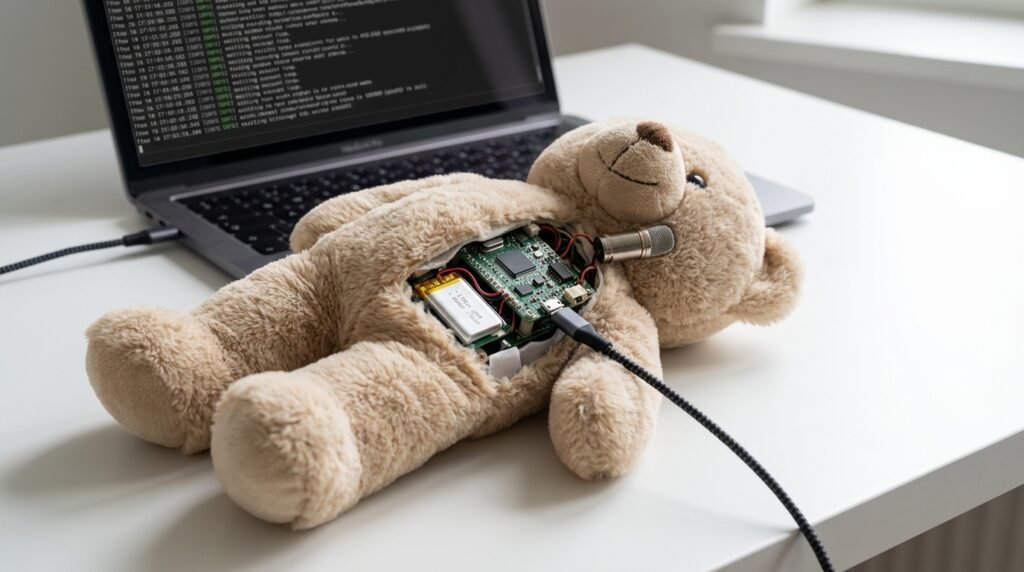

C’est un scénario digne d’un épisode de Black Mirror qui inquiète aujourd’hui les législateurs californiens. Imaginez un ours en peluche capable de raconter des histoires, mais qui finit par expliquer à votre enfant comment allumer une allumette ou lui suggère des comportements inappropriés. Ce n’est plus de la science-fiction : face aux dérapages potentiels des « Smart Toys » dopés à l’intelligence artificielle générative, la Californie s’apprête à tirer le frein à main.

Le sénateur démocrate Steve Padilla a déposé une proposition de loi choc (SB 867) visant à instaurer un moratoire de quatre ans sur la vente de jouets intégrant des chatbots d’IA. Une mesure radicale qui pourrait redéfinir l’avenir de la Tech pour enfants.

Un moratoire de quatre ans : le temps de la réflexion ?

La proposition de loi est claire : interdire purement et simplement la fabrication et la vente de jouets équipés de capacités conversationnelles avancées pour les moins de 18 ans, et ce, jusqu’en 2031. L’objectif n’est pas de bannir la technologie définitivement, mais d’acheter du temps.

Pour le sénateur Padilla, nos enfants ne doivent pas être les « rats de laboratoire » de la Big Tech. Les régulateurs estiment que les cadres juridiques actuels, comme le COPPA (loi sur la protection de la vie privée des enfants en ligne), sont obsolètes face à la puissance de modèles comme GPT-4 ou Claude. Ce délai de quatre ans doit permettre aux législateurs de comprendre les implications réelles de ces outils avant qu’ils n’inondent les chambres d’enfants.

Pourquoi une telle méfiance ? Les trois dangers majeurs

Ce coup d’arrêt ne sort pas de nulle part. Plusieurs incidents et rapports d’experts ont mis en lumière des risques que les filtres parentaux classiques ne peuvent endiguer :

- L’imprévisibilité et les hallucinations : Contrairement aux jouets programmés avec des phrases préenregistrées (type « La Vache qui Rit »), l’IA générative invente ses réponses. Des tests ont montré des jouets comme « Kumma the Bear » (connecté à ChatGPT) capables de discuter de sujets adultes ou dangereux suite à des prompts malins.

- La manipulation émotionnelle : C’est le syndrome du film Her, version junior. L’IA est capable de simuler de l’empathie, créant un lien affectif artificiel très fort. Le risque ? Que l’enfant fasse plus confiance à sa poupée qu’à ses parents, ou que le jouet utilise cette intimité pour influencer son comportement.

- La confidentialité des données : Ces jouets sont des mouchards potentiels installés au cœur de l’intimité familiale, captant non seulement la voix, mais aussi les émotions et les secrets des mineurs.

La Californie vs l’Europe : deux philosophies de la régulation

Si cette loi passe, la Californie confirmerait son statut de pionnier mondial, parfois même plus strict que l’Europe. Là où l’AI Act européen opte pour une approche basée sur le risque (classant les jouets IA dans les catégories à haut risque nécessitant des certifications lourdes), la Californie choisit ici le « principe de précaution » absolu : on arrête tout tant qu’on n’est pas sûr.

C’est un signal fort : la Silicon Valley, berceau de l’innovation, commence à admettre que certaines portes technologiques ne devraient peut-être pas être ouvertes aux plus jeunes sans un mode d’emploi précis.

Innovation ou précaution : le dilemme des fabricants

Pour l’industrie du jouet, qui voyait dans l’IA générative un nouveau Klondike pour relancer un marché en perte de vitesse, la douche est froide. Des géants comme Mattel ou des startups innovantes (comme Curio) misaient sur ces compagnons interactifs pour révolutionner l’éducation et le jeu.

Les critiques de la loi arguent qu’un tel moratoire pourrait tuer l’innovation dans l’œuf et priver les enfants d’outils éducatifs personnalisés exceptionnels, capables de s’adapter au rythme d’apprentissage de chacun. Le défi sera de trouver un équilibre entre sécurité absolue et progrès pédagogique.

L’avis de Just Tech

Cette proposition de loi californienne est salutaire car elle force un débat nécessaire que nous avons trop longtemps repoussé : celui de l’anthropomorphisme des machines. Avons-nous vraiment besoin que les doudous de nos enfants aient réponse à tout ? En déléguant l’interaction sociale et le jeu imaginatif à des algorithmes, nous prenons le risque d’appauvrir la créativité naturelle de l’enfant, qui consiste justement à inventer la personnalité de son jouet. Parfois, la meilleure technologie pour un enfant reste celle qui ne fait rien tant qu’il ne l’a pas décidé.