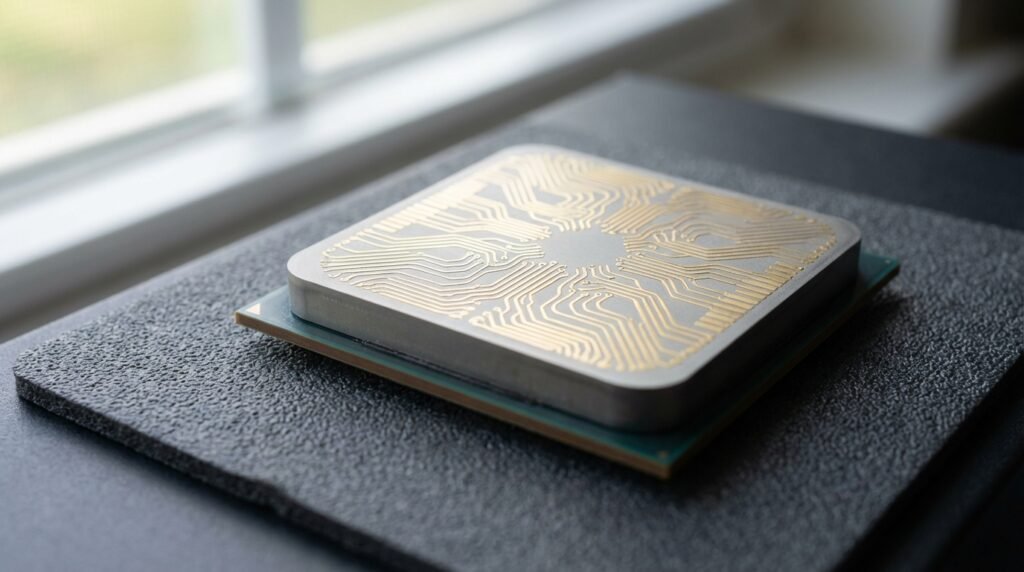

L’onde de choc Helios : Quand le silicium pèse 3 tonnes

Au CES 2026, Lisa Su n’a pas seulement présenté des puces ; elle a dévoilé une nouvelle réalité physique pour la Silicon Valley. Le rack AMD Helios, un mastodonte d’infrastructure IA de 3 tonnes, marque le point de bascule où AMD cesse d’être un simple fournisseur de composants pour devenir l’architecte en chef des supercalculateurs de demain. Ce n’est plus une lutte pour quelques points de parts de marché sur les ordinateurs portables, mais une offensive frontale contre l’hégémonie de Nvidia dans les centres de données. Avec Helios, AMD propose une solution clé en main capable de délivrer jusqu’à 2,9 exaflops de puissance en précision FP4, une prouesse qui place la barre à un niveau stratosphérique pour l’industrie.

La fiche technique du séisme : 2nm et Zen 6

Derrière le poids symbolique d’Helios se cache une débauche technologique sans précédent. Le système s’appuie sur deux piliers majeurs qui font d’AMD le premier fondeur à franchir des étapes critiques de miniaturisation et de densité :

- GPU Instinct MI455X : Gravés en 2nm, ces accélérateurs embarquent 320 milliards de transistors et 432 Go de mémoire HBM4. AMD revendique une performance 10 fois supérieure à la génération précédente, optimisée spécifiquement pour l’inférence de modèles géants.

- CPU EPYC Venice : Utilisant l’architecture Zen 6, ces processeurs proposent jusqu’à 256 cœurs. Leur rôle est crucial : nourrir les GPU en données avec une bande passante doublée, évitant tout goulot d’étranglement au sein du rack.

- Mémoire colossale : Un seul rack Helios déploie 31 To de mémoire HBM4 avec une bande passante agrégée de 1,4 Po/s.

Cette infrastructure, déjà adoptée par Meta pour ses prochains clusters, n’est pas qu’une démonstration de force ; c’est un outil industriel conçu pour l’ère de la yotta-scale computing, l’objectif affiché de Lisa Su pour 2030.

L’alliance sacrée avec OpenAI : Un partenariat d’infrastructure IA définitif

L’annonce la plus politique du salon reste sans conteste l’officialisation du partenariat entre OpenAI et AMD. Alors que Sam Altman multipliait les appels du pied pour diversifier ses sources d’approvisionnement face à la pénurie de puces Nvidia, AMD a frappé fort avec un contrat portant sur 6 gigawatts de puissance de calcul. Pour donner un ordre de grandeur, c’est assez d’énergie pour alimenter plusieurs millions de foyers, mais ici, chaque watt sera converti en intelligence artificielle.

La clause qui change tout : 10% du capital

Ce deal n’est pas une simple transaction commerciale. AMD a accordé à OpenAI des bons de souscription (warrants) pouvant représenter jusqu’à 10% du capital de l’entreprise, indexés sur le déploiement effectif des puces et des objectifs de cours de bourse. Cette intégration verticale transforme le client en actionnaire, verrouillant OpenAI dans l’écosystème AMD pour la prochaine décennie. Contrairement aux protocoles d’accord souvent non contraignants avec Nvidia, ce pacte est décrit comme définitif, faisant d’AMD le partenaire privilégié pour le projet Stargate et les futures itérations de GPT.

Ryzen AI 400 : L’IA locale n’est plus un gadget

Si Helios s’occupe du cloud, la gamme Ryzen AI 400 s’attaque à nos bureaux. Avec un NPU (Neural Processing Unit) capable de délivrer 60 TOPS, AMD dépasse largement les exigences minimales de Microsoft pour les PC Copilot+. L’objectif est clair : permettre l’exécution locale de modèles de langage (LLM) de plus de 100 milliards de paramètres sans passer par le cloud.

Les gains annoncés sont massifs : une accélération de 70 % pour la création de contenu et une efficacité multitâche améliorée de 30 %. En intégrant le support complet de la plateforme ROCm sur Windows et Linux, AMD permet aux développeurs de passer de l’entraînement sur un cluster Helios à l’exécution sur un ordinateur portable Ryzen AI sans changer une ligne de code. C’est cette continuité logicielle qui manquait cruellement à AMD pour briser le monopole de CUDA.

Conclusion : La fin du règne sans partage de Nvidia

Le CES 2026 restera dans les mémoires comme l’instant où AMD a cessé d’être le challenger pour devenir l’alternative inévitable. En combinant une avance technologique sur la gravure en 2nm, des partenariats financiers audacieux avec les géants de l’IA comme OpenAI, et une infrastructure physique comme Helios, Lisa Su a méthodiquement démantelé les barrières à l’entrée du marché haut de gamme. Nvidia reste un titan, mais pour la première fois, il n’est plus le seul à pouvoir promettre — et livrer — la puissance nécessaire à l’intelligence artificielle générale. Le marché de l’infrastructure IA est désormais un champ de bataille à deux têtes, et AMD vient d’y poser un pied de 3 tonnes.