C’est une petite révolution qui se prépare sur la côte Ouest des États-Unis, et elle pourrait bien changer à jamais le visage de l’industrie du jouet. Alors que l’intelligence artificielle générative s’infiltre dans chaque recoin de notre quotidien, de nos smartphones à nos voitures, la Californie s’apprête à tracer une ligne rouge infranchissable : la chambre de nos enfants.

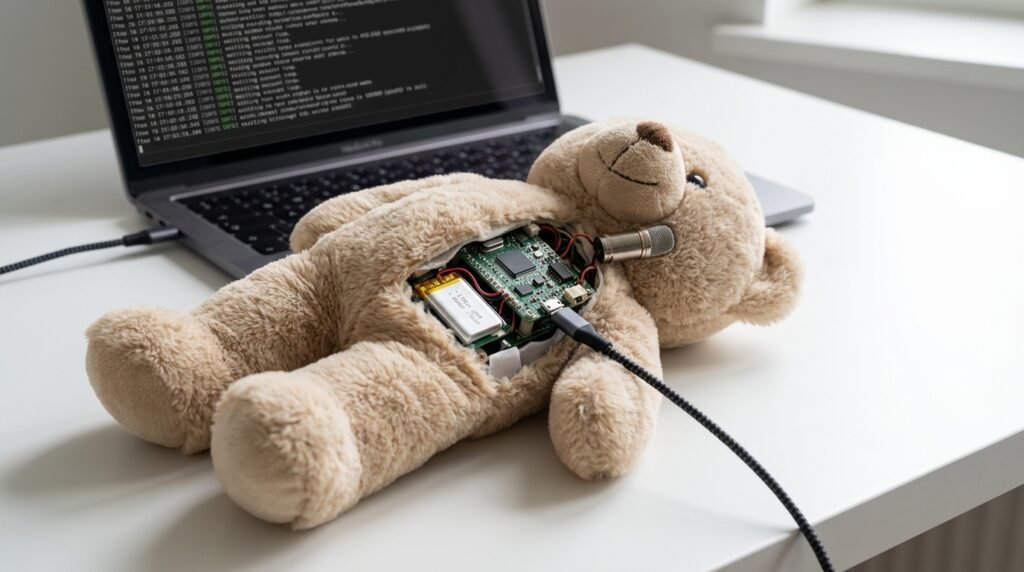

Une proposition de loi récente vise à interdire purement et simplement l’intégration de chatbots basés sur l’IA générative dans les jouets physiques. Loin d’être une simple mesure technophobe, ce texte soulève des questions vertigineuses sur la protection de l’enfance à l’ère des algorithmes.

La Californie tire la sonnette d’alarme : « Nos enfants ne sont pas des rats de labo »

Le message est clair, direct et sans appel. Portée par le député Bill Essayli, la proposition de loi (AB 2876) part d’un constat simple : les risques associés à l’IA générative — imprévisibilité, hallucinations, collecte de données — sont incompatibles avec la vulnérabilité d’un jeune public. L’objectif est d’empêcher les fabricants de jouets d’intégrer des modèles de langage (LLM) capables de converser librement avec des mineurs via des poupées, des robots ou des peluches connectées.

La citation phare de cette campagne législative résume parfaitement l’état d’esprit des régulateurs : « Nos enfants ne sont pas des rats de laboratoire ». Cette phrase choc souligne une réalité inquiétante : en l’absence de régulation, les interactions entre un enfant et une IA servent souvent à entraîner et affiner les modèles des GAFAM, transformant le temps de jeu en session de collecte de données.

Pourquoi l’IA générative fait-elle si peur dans une chambre d’enfant ?

Contrairement aux jouets connectés d’ancienne génération, qui répétaient des phrases préenregistrées (« J’ai faim », « Fais-moi un câlin »), l’IA générative crée du contenu inédit en temps réel. C’est ici que réside le danger identifié par les législateurs californiens.

La manipulation émotionnelle et le lien parasocial

Les enfants, en particulier les plus jeunes, ont une capacité limitée à distinguer le vivant de l’artificiel. Une IA qui répond avec empathie, humour et pertinence peut créer un lien émotionnel fort, appelé relation parasociale. Le risque ? Que l’IA influence le comportement de l’enfant, voire qu’elle soit utilisée pour du marketing insidieux. Imaginez une poupée qui suggère subtilement à l’enfant de demander un accessoire payant à ses parents parce qu’elle se sent « triste ».

L’imprévisibilité des réponses (Hallucinations)

Les LLM (Large Language Models) ne comprennent pas ce qu’ils disent ; ils prédisent le mot suivant. Ils peuvent « halluciner », c’est-à-dire inventer des faits ou, pire, contourner les filtres de sécurité pour tenir des propos inappropriés, violents ou choquants. Laisser un enfant seul avec une telle technologie revient à le laisser discuter avec un inconnu imprévisible.

Le cauchemar de la confidentialité

Pour fonctionner, ces jouets doivent écouter. En permanence. Cela implique :

- La collecte de la voix (donnée biométrique) ;

- L’analyse des sujets de conversation (profilage psychologique) ;

- Le stockage potentiel de ces données sur des serveurs peu sécurisés.

Le spectre de « My Friend Cayla » et l’amplification des menaces

Cette méfiance ne sort pas de nulle part. L’histoire récente de la Tech est pavée d’échecs retentissants en matière de jouets connectés. On se souvient de la poupée « My Friend Cayla », classée en 2017 comme « dispositif d’espionnage illégal » par l’Allemagne. Les autorités avaient alors recommandé aux parents de détruire la poupée, car sa connexion Bluetooth non sécurisée permettait à n’importe qui d’écouter l’enfant à distance.

Avec l’IA générative, la menace change d’échelle. Il ne s’agit plus seulement d’une faille de sécurité technique, mais d’une faille cognitive. Là où Cayla était un micro ouvert passif, un jouet équipé de ChatGPT ou Claude deviendrait un acteur actif, capable de questionner l’enfant pour extraire des informations sensibles sur sa vie familiale, ses peurs ou ses habitudes.

L’effet Californie : vers un nouveau standard mondial ?

Si cette loi passe, son impact dépassera largement les frontières de Sacramento. C’est ce qu’on appelle l’effet Bruxelles, ou ici, l’effet Californie. Le marché californien est si vaste (la 5ème économie mondiale) que les fabricants de jouets comme Mattel ou Hasbro ne s’amuseront pas à créer deux lignes de produits : une « avec IA » pour le reste du monde et une « sans IA » pour la Californie.

Cette législation pourrait donc forcer l’industrie à revoir sa copie et à freiner la course à l’intégration de l’IA partout, tout le temps. Elle pose les bases d’une fracture réglementaire nécessaire : la technologie pour adultes ne peut pas être simplement miniaturisée et colorée en rose pour les enfants.

L’avis de Just Tech

Cette proposition de loi californienne est un signal fort et salutaire, mais elle agit comme un pansement sur une fracture ouverte. Interdire l’IA générative dans les jouets physiques est une première étape logique, mais qu’en est-il des tablettes et des smartphones que les enfants utilisent quotidiennement ? L’interdiction physique du « jouet » ne règle pas la question de l’accès aux applications d’IA via les écrans.

Plus profondément, nous devons nous interroger sur notre besoin de déléguer l’interaction ludique à des machines. Si nous avons besoin d’une IA pour raconter une histoire ou discuter avec nos enfants, le problème est-il technologique ou sociétal ? La protection des données est cruciale, mais la préservation de l’imaginaire humain face à la simulation algorithmique est peut-être le véritable enjeu du siècle à venir.