On nous promet la voiture autonome pour « demain » depuis dix ans. Mais jusqu’à présent, « demain » ressemblait toujours à une ligne d’horizon qui recule à mesure qu’on avance. Ce 5 janvier 2026, au CES de Las Vegas, Jensen Huang a peut-être enfin brisé cette malédiction. En dévoilant Alpamayo, une nouvelle famille de modèles d’IA, le patron de Nvidia ne vend pas seulement des puces plus rapides : il propose de greffer un cortex préfrontal aux véhicules.

Pour la première fois, une voiture ne se contentera plus de « voir » et « agir ». Elle va « raisonner ». Voici pourquoi c’est le chaînon manquant vers l’autonomie de niveau 5.

Du réflexe à la réflexion : le saut vers le « System 2 »

Jusqu’à aujourd’hui, les meilleures voitures autonomes (y compris les FSD de Tesla) fonctionnaient principalement sur du « System 1 » : une pensée rapide, intuitive, quasi-réflexe. La caméra voit un feu rouge, la voiture freine. C’est efficace pour 99% de la conduite. Mais c’est le 1% restant — les fameux edge cases — qui paralyse l’industrie.

Avec Alpamayo, Nvidia introduit le « System 2 » dans l’habitacle. Inspiré par les modèles de langage type o1, ce modèle Vision-Language-Action (VLA) de 10 milliards de paramètres est capable de marquer un temps d’arrêt (virtuel) pour analyser une situation inédite.

- Situation complexe : Un policier vous fait signe de passer alors que le feu est rouge à cause d’un accident.

- Réaction classique (System 1) : Blocage. Le code dit « feu rouge = arrêt ». La voiture s’immobilise et crée un bouchon.

- Réaction Alpamayo (System 2) : Le modèle analyse la gestuelle, comprend le contexte d’urgence, déduit que l’autorité du policier prévaut sur le feu, et décide d’avancer prudemment.

Comme l’a résumé Jensen Huang : « C’est le moment ChatGPT pour l’IA physique. »

Vera Rubin : la centrale nucléaire dans le coffre

Pourquoi n’a-t-on pas fait cela plus tôt ? Parce que « réfléchir » coûte cher. Très cher en ressources de calcul. C’est ici que la stratégie hardware de Nvidia prend tout son sens. Alpamayo est gourmand : il ne fait pas que de la détection de pixels, il génère des chaînes de pensée (Chain-of-Thought) en temps réel.

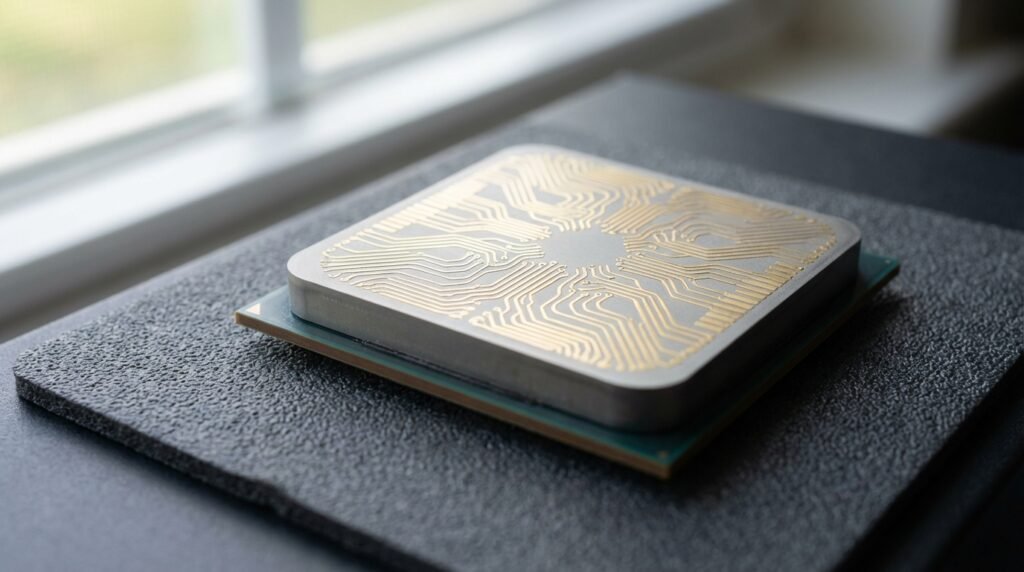

Pour supporter cette charge, Nvidia déploie son architecture Vera Rubin. Succédant à Blackwell, ces puces intègrent de la mémoire HBM4 à très haute bande passante. L’enjeu n’est plus seulement d’afficher des polygones, mais de permettre à la voiture de simuler plusieurs futurs possibles en quelques millisecondes avant de choisir le plus sûr.

La stratégie de l’Android de l’autonomie

Là où Tesla joue la carte du jardin fermé (Apple/iOS) avec son approche End-to-End propriétaire, Nvidia se positionne clairement comme le « Google/Android » de la mobilité. En rendant Alpamayo open-source (disponible sur Hugging Face) et en fournissant les outils de simulation (AlpaSim), Nvidia s’assure que tout le reste de l’industrie — de Mercedes (qui l’intégrera dès le premier trimestre dans sa CLA) à Jaguar Land Rover — devienne dépendant de ses cerveaux de silicium.

L’avis de Just Tech

L’arrivée d’Alpamayo marque une rupture fascinante : la fin de la « boîte noire ». Le plus grand frein à l’adoption de la voiture autonome n’est pas technologique, mais psychologique. Nous n’avons pas confiance car nous ne savons pas pourquoi la machine décide de freiner brutalement.

Si Alpamayo tient ses promesses, il pourra verbaliser son raisonnement : « Je me déporte car je vois un enfant instable sur le trottoir de droite. » Paradoxalement, pour que nous acceptions de lâcher le volant, il fallait peut-être que la voiture devienne capable de nous parler comme un moniteur d’auto-école. Reste une question : si la voiture « raisonne » et se trompe, la responsabilité juridique glisse-t-elle du constructeur vers le concepteur du modèle de pensée ? Le débat ne fait que commencer.