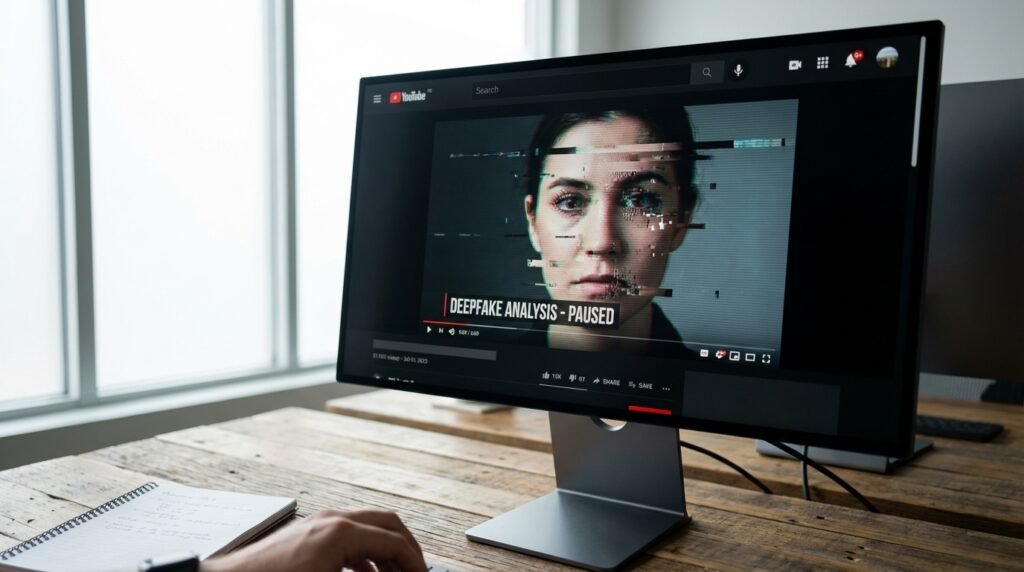

C’est une scène digne d’un épisode de Black Mirror, mais elle s’est déroulée sur l’écran d’ordinateur de l’ancien ministre des Finances grec. Yanis Varoufakis regarde une vidéo de lui-même. L’image est nette, la voix est la sienne, le ton est familier. Il se voit assis à son bureau d’Athènes, portant une chemise bleue. Pourtant, un frisson le parcourt : cette chemise n’a jamais quitté sa maison de vacances sur une île, et il n’a jamais prononcé ces mots sur le Venezuela. Ce qu’il regarde, c’est un fantôme numérique, une marionnette algorithmique qui a volé son visage et sa voix.

Dans une tribune glaçante publiée par The Guardian début 2026, l’économiste lance l’alerte. Au-delà de l’anecdote personnelle, son expérience marque un tournant : nous sommes entrés dans l’ère de la post-vérité audiovisuelle.

L’attaque des clones : quand l’IA devient une hydre

Ce qui frappe dans le témoignage de Varoufakis, ce n’est pas tant la perfection technique du deepfake – bien que celle-ci soit désormais suffisante pour tromper un œil inattentif – que l’industrialisation du processus. Il ne s’agit pas d’une vidéo isolée, mais d’une inondation.

La mécanique décrite est celle d’une guerre asymétrique perdue d’avance pour l’individu :

- Viralité instantanée : Les vidéos cumulent des centaines de milliers de vues en quelques heures, mélangeant habilement des propos plausibles et des fabrications pures.

- L’effet Hydre de Lerne : À peine une chaîne YouTube frauduleuse est-elle signalée et fermée que le contenu réapparaît immédiatement sur trois autres comptes.

- Confusion totale : Même ses partisans les plus fidèles lui écrivent, désemparés : « Yanis, as-tu vraiment dit ça ? ».

L’économiste y voit la validation de sa théorie du « technoféodalisme ». Nous ne sommes plus propriétaires de rien, pas même de notre identité audiovisuelle. Nous sommes de simples locataires sur les terres numériques des géants de la Tech, qui laissent nos doubles virtuels proliférer pour maximiser l’engagement.

La fin de la preuve par l’image

L’affaire Varoufakis illustre un danger systémique bien plus grand que la diffamation : l’érosion du concept de preuve. Jusqu’ici, la vidéo était le juge de paix ultime. Si on le voyait, c’était arrivé.

Aujourd’hui, cette certitude vole en éclats. Le risque n’est pas seulement que l’on croie au faux, mais que l’on ne croie plus au vrai. Les experts appellent cela le « dividende du menteur » : dans un monde saturé de faux, n’importe quel politique pris la main dans le sac pourra balayer une vidéo compromettante bien réelle en criant au deepfake. La vérité commune, socle du débat démocratique, se dissout dans un doute permanent.

L’impuissance des outils de détection

Face à cette menace, la réponse technologique et législative semble dérisoire. Les outils de détection d’IA (watermarking, analyse spectrale) sont constamment en retard d’une guerre sur les générateurs d’images. Quant aux plateformes comme YouTube ou X (anciennement Twitter), leur modération est dépassée par le volume et la vitesse de propagation.

Varoufakis souligne une ironie amère : l’IA, qui devait démocratiser la création, est en train de détruire l’isegoria, ce principe athénien de l’égalité de parole. Au lieu d’enrichir le débat, elle le noie sous un bruit synthétique où la parole authentique devient indiscernable du bruit généré par des machines.

L’avis de Just Tech

L’expérience de Yanis Varoufakis doit agir comme un électrochoc. Nous avons trop longtemps focalisé le débat sur la « qualité » des deepfakes, en nous demandant si on pouvait encore voir les défauts (les fameux doigts en trop). C’est un faux débat. La technologie sera bientôt parfaite. La vraie question est celle de la chaîne de confiance. Si nous ne pouvons plus croire nos yeux, nous devons réinventer la manière dont nous validons l’information. Allons-nous vers un monde où seule la rencontre physique fera foi ? Ou devrons-nous accepter de signer cryptographiquement chaque seconde de notre vie numérique ? L’IA nous force à choisir : soit nous construisons une infrastructure de vérité inviolable, soit nous acceptons de vivre dans un hall des miroirs permanent.